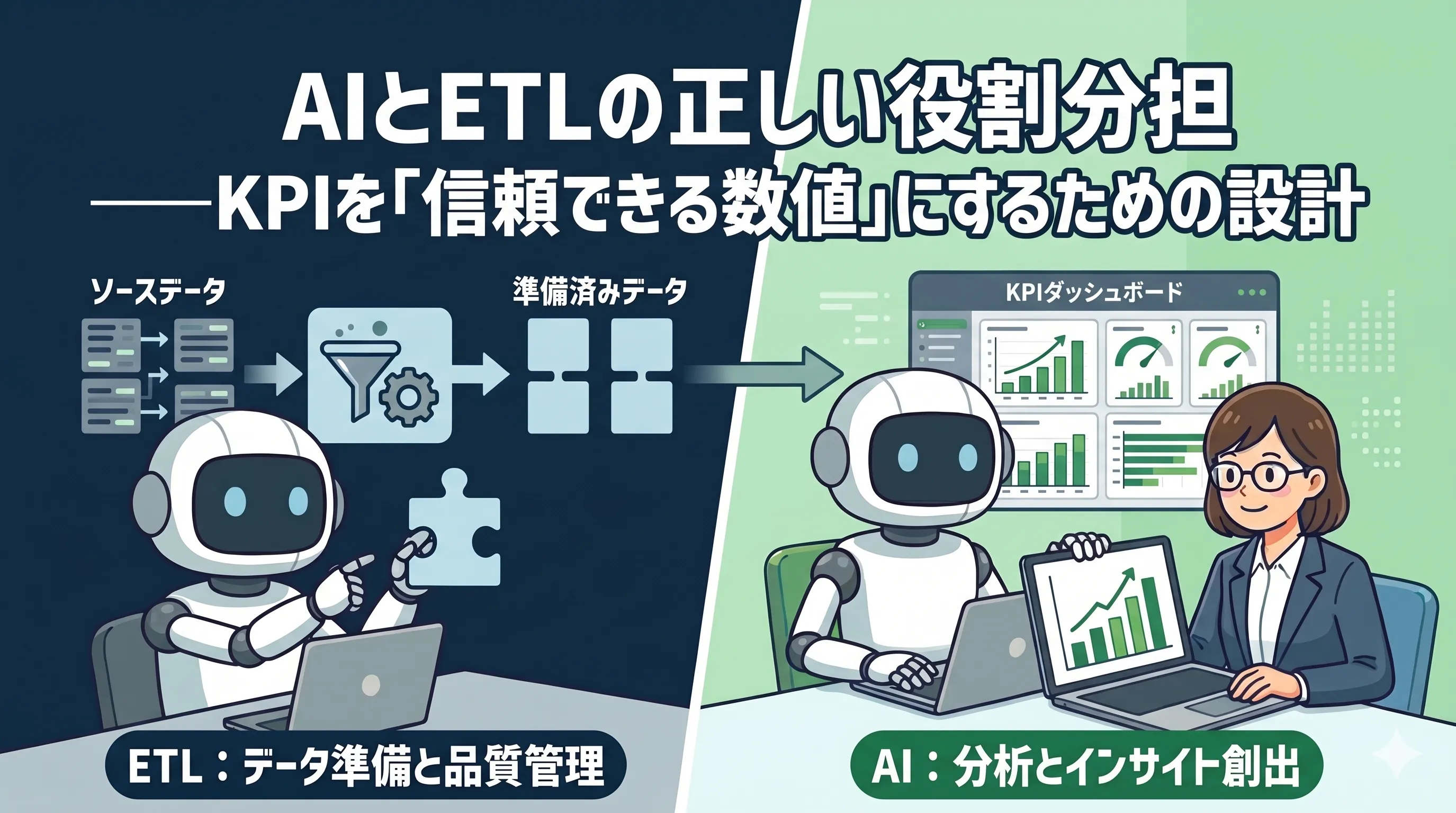

AIとETLの正しい役割分担——KPIを「信頼できる数値」にするための設計

「AIを入れたのに、なぜかデータ活用がうまくいかない」

こうした声を、データ担当者やアナリストからよく聞くようになりました。AIツールを導入し、集計やレポートに活用しているにもかかわらず、数値への信頼が高まらない——その背景には、AIとETLの役割分担が設計されていないという問題があります。

本記事では、KPIを「信頼できる数値」にするために必要な、AIとETLツールの役割分担の考え方を解説します。

目次

- なぜ「AIだけ」では数値の信頼性が担保できないのか

- ETLとは何か——「確定値を作る機械」

- 役割分担の設計原則:「確定値はETL、意味はAI」

- 実際の業務フローで見る分担例

- Reckonerを使った具体的な実装

- 判断に迷ったときのチェックリスト

- よくある誤解と正しい理解

- まとめ

- 次のステップ

なぜ「AIだけ」では数値の信頼性が担保できないのか

生成AIは、与えられた情報から「もっともらしい回答」を生成するように設計されています。これは多くの業務で非常に有効ですが、集計・KPI算出という観点では根本的な問題をはらんでいます。

LLMの3つの性質が「確定値」と相性が悪い

① 確率的な出力

同じプロンプトを送っても、内部では毎回異なる計算経路をたどります。temperatureパラメータがゼロでない限り、出力には揺らぎが生じます。

② プロンプト依存の解釈

「先月の売上」「受注件数」といった言葉の定義はプロンプトに依存します。プロンプトの書き方が変わると、集計範囲や条件の解釈も変わります。

③ 再現性のなさ

過去に出力した数値をまったく同じ手順で再現できる保証がありません。これは監査対応や数値の追跡調査で致命的な問題になります。

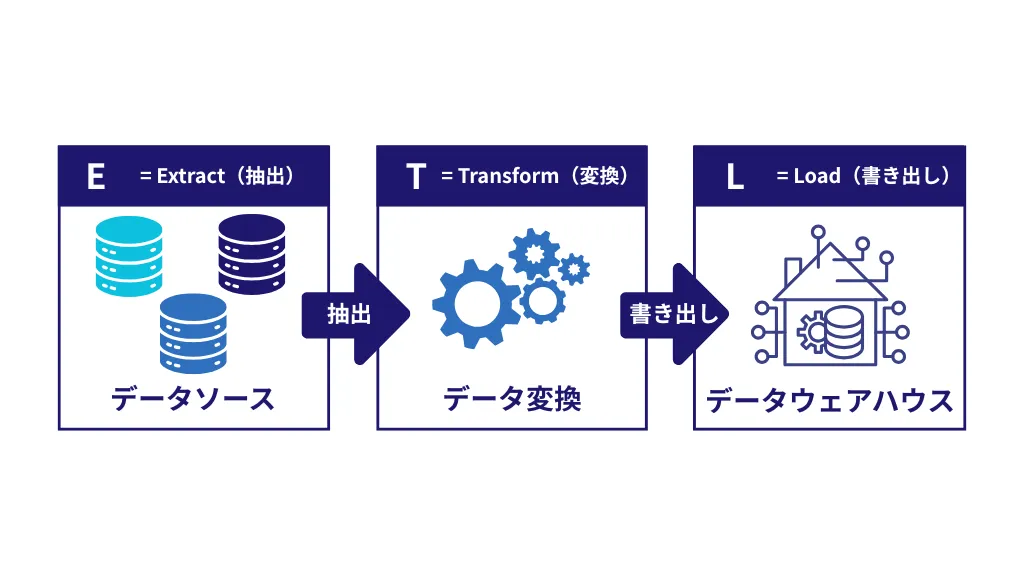

ETLとは何か——「確定値を作る機械」

ETL(Extract/Transform/Load)は、データを「抽出→変換→格納」するための仕組みです。

ETLの最大の特徴はルールベースで動くことです。集計条件・変換ロジック・名寄せルールをコード(またはノード)として定義するため、同じ入力に対して常に同じ出力を返します。

| 特性 | ETL | AI(LLM) |

|---|---|---|

| 出力の再現性 | ✅ 常に同じ結果 | ❌ 毎回変わりうる |

| ロジックの可視化 | ✅ フローとして記録 | ❌ プロンプト依存 |

| 監査への対応 | ✅ リネージを自動記録 | ❌ 根拠を示せない |

| 自然言語の解釈 | ❌ できない | ✅ 得意 |

| インサイト抽出 | ❌ できない | ✅ 得意 |

| 傾向・異常の説明 | ❌ できない | ✅ 得意 |

この表が示すように、ETLとAIは互いの弱点を補い合う関係にあります。

役割分担の設計原則:「確定値はETL、意味はAI」

KPIを信頼できる数値にするための設計原則はシンプルです。

確定値を作る工程はETL、意味を読み解く工程はAI

具体的には次のように分担します。

ETLが担当する工程

- 複数SaaSからのデータ収集・統合

- 表記ゆれの吸収・名寄せ処理

- KPI定義に基づく集計・算出

- データウェアハウスへの格納

- 定期実行・自動更新

これらはすべて「同じ結果を繰り返し生成する」ことが求められる工程です。ETLはここで圧倒的な強みを発揮します。

AIが担当する工程

- ETLが出力した確定値を受け取る

- 前月比・前年比のトレンドを説明する

- 異常値・注目すべき変化を検出・コメントする

- 経営レポートの文章を自動生成する

- 「なぜこの数値になったか」の仮説を提示する

AIは確定した数値の上で動くことで、ハルシネーションのリスクを大幅に減らせます。「作られた数値が正しいか」ではなく「正しい数値が何を意味するか」だけを考えればいいからです。

実際の業務フローで見る分担例

月次KPIレポートの場合

従来(AI任せ)

担当者がChatGPTにCSVを貼り付け

→ 「月次KPIをまとめて」と依頼

→ AIが集計・サマリーを生成

→ 数値のブレ・ハルシネーションリスク

→ 報告前に手動確認が必要推奨(ETL + AI分担)

Reckoner(ETL)が毎月自動でデータを収集・集計

→ 確定KPI値をデータウェアハウスに格納

→ AIが確定値を受け取り、トレンドとインサイトを生成

→ 担当者は内容を確認するだけ後者のフローでは、数値の正確性はETLが保証し、AIは「意味の生成」に集中できます。

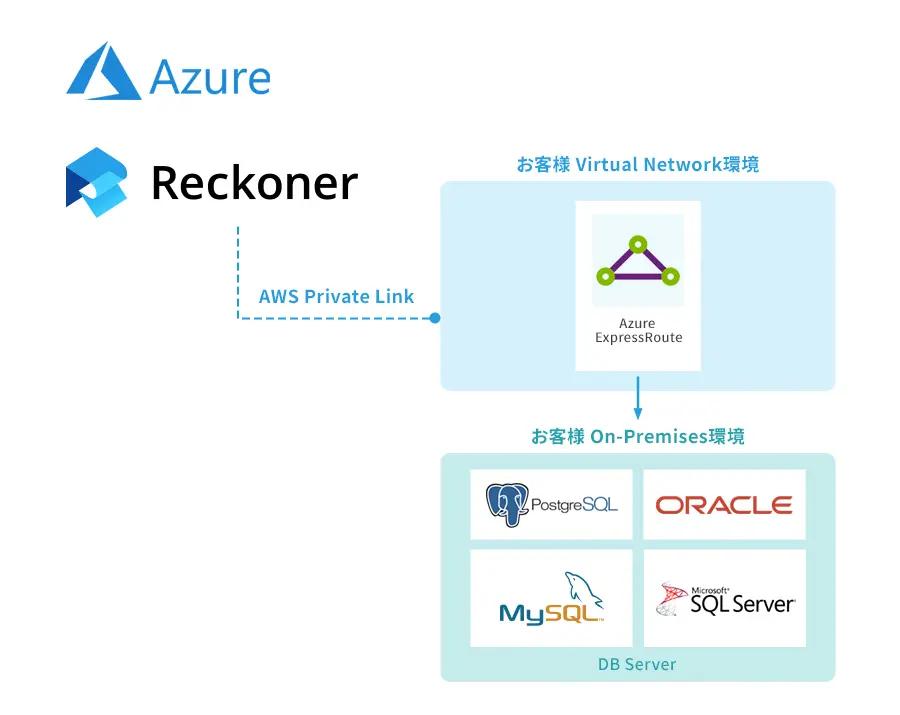

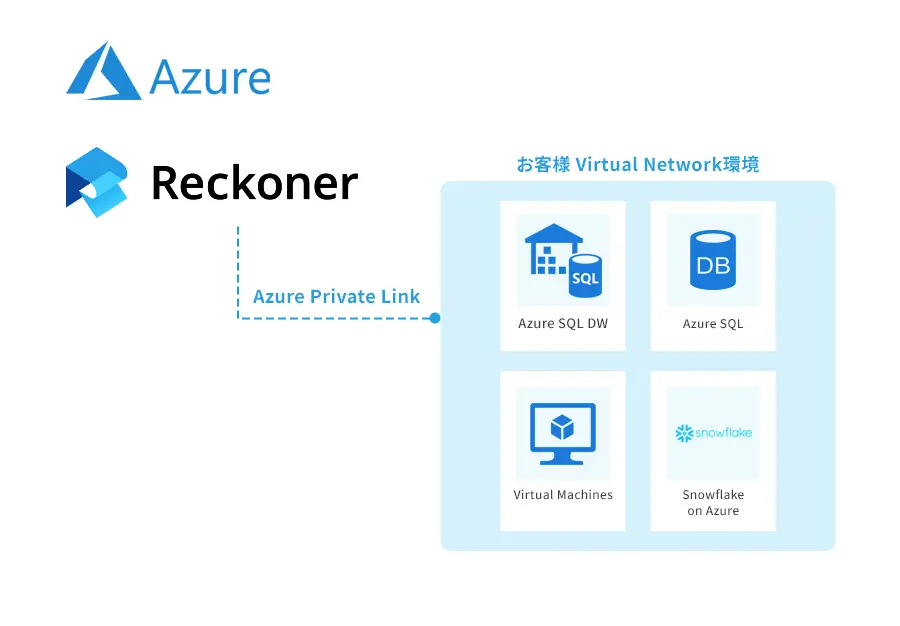

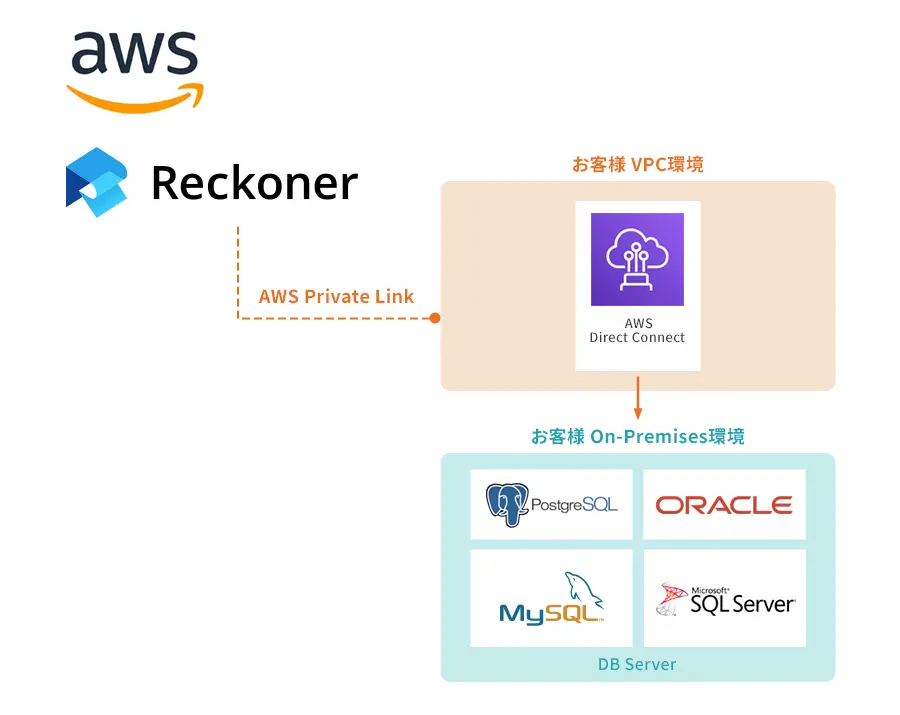

Reckonerを使った具体的な実装

Reckonerは、この「確定値はETL、意味はAI」という設計を実現するためのクラウド型ETLツールです。

Reckonerでできること

コネクタによるデータ収集

Salesforce、HubSpot、Google Analytics、kintoneなど100以上のSaaSやデータベースに接続できます。バラバラのソースから必要なデータを自動収集します。

ノードによる集計ロジックの定義

KPIの計算条件・フィルタ・名寄せルールを視覚的なフローとして定義します。SQLやPythonの知識がなくても設定可能です。定義したロジックはチームで共有でき、変更履歴も残ります。

スケジュール実行

「毎朝9時に実行」「毎月1日に実行」などのスケジュールを設定することで、手作業ゼロの自動集計が実現します。

データリネージの記録

「このKPIはどのデータから、どのロジックで算出されたか」を自動記録します。監査対応・証跡管理にも対応しています。

判断に迷ったときのチェックリスト

「この業務はAIに任せるべきか、ETLに任せるべきか」——迷ったときは以下で判断してください。

ETL(Reckoner)に任せるべき場合

- 毎回同じ結果が必要な場合

- 監査や証跡が求められる場合

- 定期実行・自動化したい場合

- 複数ソースの突合が必要な場合

- 担当者が変わっても同じ結果を再現したい場合

AIに任せてよい場合

- 傾向・パターンを言語化したい場合

- レポートのサマリー文を自動生成したい場合

- 異常値への仮説・コメントを生成したい場合

- 大量のテキストから定性情報を整理したい場合

よくある誤解と正しい理解

誤解①「ETLは難しい」

Reckonerのようなノーコード対応のETLツールなら、エンジニアでなくても設定できます。ドラッグ&ドロップでフローを構築でき、最短1日でデータ連携を開始できます。

誤解②「AIの方が柔軟で便利」

柔軟さは集計業務では弱点になります。「今回はこう解釈した」がコントロールできないAIより、「常にこのルールで計算する」ETLの方が、定常業務には向いています。

誤解③「どうせ最後は人が確認するから同じ」

人が確認する工数は無視できません。ETLで正確な数値が自動生成されていれば、人が行うのは「内容を読んで判断する」作業だけになります。AIの出力を毎回検証する工数は、実は大きなコストです。

まとめ

- AIは「もっともらしい回答」を生成するため、集計値の再現性・正確性には向いていない

- ETLは「ルールベースで再現性のある処理」が得意で、確定値の生成に向いている

- 「確定値はETL、意味はAI」の分業体制が、信頼できるデータ活用の設計原則

- Reckonerはこの設計を実現するためのノーコードETLツール

- まず「どの業務がAIで、どの業務がETLか」を整理することが、データ基盤改善の第一歩

次のステップ

本記事の内容をより詳しく解説したホワイトペーパー「数値化の信頼性を守る — AIに任せるべき仕事、ツールに任せるべき仕事」を無料配布しています。業務別マトリクス・失敗シナリオ・導入3ステップを収録しています。